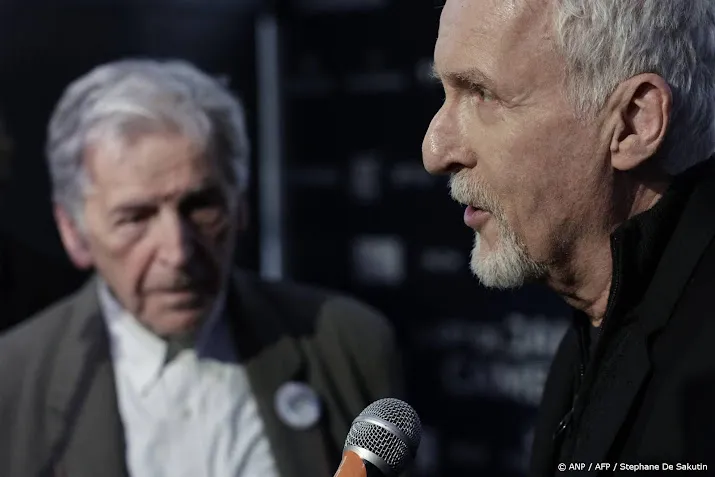

James Cameron vreest dat AI mensheid zou kunnen vernietigen

09 aug 2025, 21:50 • Entertainment

James Cameron vreest dat zijn film Terminator, over kunstmatige intelligentie die de mensheid bijna vernietigt, werkelijkheid zou kunnen worden als AI ooit wordt gekoppeld aan wapensystemen. Dat zegt de regisseur in een gesprek met Rolling Stone.

"Ik denk dat er nog steeds gevaar is voor een apocalyps à la Terminator, waarbij je AI combineert met wapensystemen, zelfs tot op het niveau van kernwapensystemen, nucleaire verdediging en tegenaanvallen, al dat soort dingen", zegt de 70-jarige Cameron. Volgens hem heb je "superintelligentie" nodig om dat allemaal te kunnen verwerken. "Maar misschien zijn we slim genoeg om een mens in de beslissingsketen te houden."

"Maar mensen zijn feilbaar", vervolgt Cameron. "En er zijn veel fouten gemaakt die ons op de rand van internationale incidenten hebben gebracht en tot een kernoorlog hadden kunnen leiden." Terminator uit 1984 gaat over een AI-netwerk dat in de toekomst een cyborg naar de jaren tachtig stuurt om de moeder van de toekomstige leider van het verzet te doden.

Cameron beschouwt "superintelligentie", een nog niet gecreëerde versie van AI, als een van de grootste bedreigingen voor de mensheid naast klimaatverandering en kernwapens. "We staan op een keerpunt in de menselijke ontwikkeling waar je drie existentiële bedreigingen hebt: klimaat, kernwapens en superintelligentie."

loading

Loading